Roboty, które potrafią dokładnie naśladować działania i ruchy człowieka w czasie rzeczywistym mogłyby być niezwykle przydatne, ponieważ byłby w stanie uczyć się wykonywać codziennych zadań w określony sposób bez konieczności wcześniejszego programowania tych zadań. Chociaż w ciągu ostatnich kilku lat techniki umożliwiające uczenie się przez naśladownictwo znacznie się poprawiły, ich działanie często utrudnia brak zgodności między konstrukcją robota a ciałem naśladowanego człowieka.

Naukowcy z U2IS i ENSTA Paris wprowadzili niedawno nowy model oparty na głębokim uczeniu się, który może ulepszyć możliwości imitacji ruchu humanoidalnych systemów robotycznych. Model przedstawia imitację ruchu w trzech odrębnych etapach mających na celu ograniczenie zgłaszanych w przeszłości problemów związanych z koherencją ciała człowieka i robota.

- Te wczesne prace badawcze mają na celu ulepszenie naśladowania poprzez przełożenie sekwencji wspólnych pozycji z domeny ruchów człowieka na dziedzinę ruchów osiągalnych przez danego robota - napisali w swoim artykule Louis Annabi, Ziqi Ma i Sao Mai Nguyen - Wykorzystując możliwości uogólniania metod głębokiego uczenia się, rozwiązujemy ten problem, proponując model sieci neuronowej koder-dekoder wykonujący translację z domeny na domenę.

Model opracowany przez Annabiego, Ma i Nguyena dzieli proces naśladowania człowieka i robota na trzy kluczowe etapy, a mianowicie oszacowanie pozycji, ponowne ukierunkowanie ruchu i sterowanie robotem.

Wykorzystuje algorytmy szacowania pozycji do przewidywania sekwencji pozycji szkieletu i stawów, które stanowią podstawę ruchów wykazywanych przez ludzkie stawy. Następnie model przekłada tę sekwencję na podobne pozycje przegubów, które w realistyczny sposób mogą zostać wytworzone przez ciało robota. Wreszcie są one wykorzystywane do planowania trajektorii robota, co teoretycznie skutkuje dynamicznymi ruchami, które mogą pomóc robotowi w wykonaniu danego zadania.

- Aby wytrenować taki model, można by wykorzystać pary powiązanych ruchów robota i człowieka, jednak takie sparowane dane są w praktyce niezwykle rzadkie, a ich gromadzenie jest niezwykle żmudne - podkreślili naukowcy - Z tego powodu zwracamy się w kierunku metod głębokiego uczenia się w celu realizacji niesparowanej translacji między domenami, które dostosowujemy, aby naśladować człowieka i robota.

Badacze ocenili wydajność swojego modelu w serii wstępnych testów, porównując go z prostszą metodą odtwarzania wspólnych orientacji, która nie jest oparta na głębokim uczeniu się. Ich model nie osiągnął oczekiwanych wyników, co sugeruje, że obecne metody głębokiego uczenia się mogą nie być w stanie skutecznie ukierunkowywać ruchów w czasie rzeczywistym.

Naukowcy planują teraz przeprowadzić dalsze eksperymenty, aby zidentyfikować potencjalne problemy w swoim podejściu, aby móc się nimi zająć i dostosować model w celu poprawy jego wydajności. Dotychczasowe ustalenia zespołu sugerują, że chociaż techniki głębokiego uczenia się bez nadzoru można wykorzystać do umożliwienia uczenia się przez naśladownictwo w robotach, ich wydajność wciąż nie jest wystarczająco dobra, aby można je było zastosować w prawdziwych realiach.

- Przyszłe prace poszerzą obecne badanie w trzech kierunkach: dalsze studiowanie niepowodzeń obecnej metody, utworzenie zbioru danych dotyczących sparowanych danych o ruchu na podstawie imitacji człowiek-człowiek lub robot-człowiek oraz udoskonalenie architektury modelu w celu uzyskania dokładniejszych przewidywań dotyczących zmiany celu sterowania - podsumowali naukowcy.

(rr)

Kategoria wiadomości:

Nowinki techniczne

- Źródło:

- techxplore

Komentarze (0)

Czytaj także

-

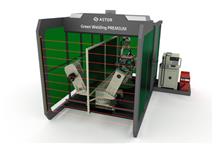

Jak zautomatyzować każdy proces przemysłowy?

Automatyzacja procesów jest kluczem do obniżania kosztów produkcji. Nie zawsze jest to proste, bo na proces przemysłowy składa się wiele...

-

Jak przebiega projektowanie konstrukcji stalowych?

Projektowanie konstrukcji stalowych to złożony proces, który wymaga uwzględnienia wielu czynników, takich jak obciążenie, warunki środowiskowe,...

-

-

-

-

-

-